Très bon article (en anglais) de factodesign.

Une bonne et belle visualisation, cela explique tout!

cliquez sur l’image pour accéder à l’article

mind Media analyse l’impact du texte à l’aide de spécialistes. En gras, les dispositions du texte, suivies de nos commentaires et ceux d’experts.

Décret n°2017-159 du 9 février 2017 relatif aux prestations de publicité digitale

Article 1

Le présent décret s’applique, pour l’application de l’article 23 de la loi du 29 janvier 1993 susvisée, aux prestations de publicité digitale entendues comme celles ayant pour objet la diffusion de messages sur tous supports connectés à internet tels qu’ordinateurs, tablettes, téléphones mobiles, téléviseurs et panneaux numériques.

« On précise ici que les principes de la Loi Sapin de 1993 (relative à la prévention de la corruption et à la transparence de la vie économique et des procédures publiques, ndlr) sur la publicité s’appliquent aussi au digital, ce qui n’était pas formalisé clairement par la version originale. C’était implicite, mais beaucoup d’acteurs du digital en ont profité pour ne pas appliquer toutes ses composantes. Apporter cet éclairage est une avancée, mais pour quelques temps seulement… On parle en effet de “supports connectés à internet”, en les listant. Mais quid des objets connectés qui vont se développer, notamment ceux reliés à une station d’accueil, qui, elle, est reliée au web ? Et le décret s’applique-t-il quand on est hors connexion internet ? Autant de situations qui pourront créer de nouveaux problèmes d’application.”

Article 2

S’agissant des prestations de publicité digitale mentionnées à l’article 1er, à l’exception de celles définies à l’article 3 ci-dessous, le compte-rendu communiqué par le vendeur d’espace publicitaire à l’annonceur précise la date et les emplacements de diffusion des annonces, le prix global de la campagne, ainsi que le prix unitaire des espaces publicitaires facturés. Les sites ou ensemble des sites internet sur lesquels les annonces sont diffusées peuvent être regroupés en fonction de leur nature ou de leurs contenus éditoriaux. Le prix global de la campagne, ainsi que le prix unitaire des espaces publicitaires facturés

L’article 2 concerne le gré à gré. On précise ici que sur le digital hors programmatique, le vendeur doit fournir, comme sur les autres médias, un compte-rendu complet sur la campagne, insertion par insertion, intégrant le coût unitaire des espaces facturés. C’est ce que demande l’UDA pour déterminer le coût initial. Ou l’ensemble des sites internet

“Si l’annonceur achète un package, le vendeur fournira-t-il un compte-rendu de sa composition, ou seulement pour l’ensemble ? Par ailleurs, tous les formats n’ont pas les mêmes noms ou tailles : comment les rapprocher ? Cela va dans le sens de l’harmonisation des formats sur laquelle travaille l’IAB US. Les éditeurs devront adapter leurs formats publicitaires.”

Article 3

Pour les campagnes de publicité digitale qui s’appuient sur des méthodes d’achat de prestations en temps réel sur des espaces non garantis, notamment par des mécanismes d’enchères, pour lesquelles les critères déterminants de l’achat sont le profil de l’internaute et l’optimisation de la performance du message, le vendeur d’espace publicitaire communique à l’annonceur un compte-rendu comportant au moins les informations suivantes :

1° Au titre des informations permettant de s’assurer de l’exécution effective des prestations et de leurs caractéristiques :

a) L’univers de diffusion publicitaire, entendu comme les sites ou l’ensemble de sites internet qui peuvent être regroupés en fonction de leur nature ou de leurs contenus éditoriaux ;

b) Le contenu des messages publicitaires diffusés ;

c) Les formats utilisés ;

d) Le résultat des prestations au regard du ou des indicateurs de performance convenus lors de l’achat des prestations, tels que le nombre d’affichages publicitaires réalisés (par exemple « impressions », « pages vues »), le nombre d’interactions intervenues entre l’internaute et les affichages publicitaires (par exemple « clics », « actions ») ou toute autre unité de mesure justifiant l’exécution des prestations ;

e) Le montant global facturé pour une même campagne publicitaire et le cas échéant tout autre élément, convenu avec l’annonceur, relatif au prix des espaces ;

“L’article 3 vise à mon sens les trading desks d’agences non transparents, ayant parfois le statut ou la position de régies (c’est le cas d’Affiperf chez Havas et d’Amnet chez Dentsu Aegis Network, ndlr) au sein des groupes de communication. Il faut cesser avec ces organisations horizontales, les activités programmatiques doivent être pleinement réintégrées dans les agences, comme l’a fait récemment Publicis Media, ou GroupM depuis toujours. C’est plus clair et plus sain, pour garantir plus de transparence sur l’activité de mandataire auprès de l’annonceur et les compte-rendus : sur le prix et la qualité de l’espace, le taux de marge, le prix des outils programmatiques et annexes…”

L’article 3 concerne le programmatique. Il indique que le reporting doit être effectué à l’annonceur par le “vendeur d’espace”. Tout l’enjeu va être de déterminer ce qu’est un vendeur sur la chaîne programmatique, alors que de nombreux intermédiaires occupent ce rôle. Sur quel(s) vendeur(s) reposera l’obligation d’information à l’annonceur ? La régie ? Le trading desk ? Le SSP ? Le DSP ? La possibilité, un temps envisagé, d’introduire un statut d’acheteur-revendeur ne figure pas dans le décret car il contredirait la Loi Sapin. Dans une lecture littérale du décret, il n’y a qu’un seul type de vendeur : la charge du reporting incombe à l’éditeur et sa régie. C’est d’ailleurs ce qu’estime l’UDA. Difficile à accepter pour les éditeurs et le SRI, lequel prend déjà position sur une définition plus large, qu’elle estime “pragmatique”. Les acteurs ont dix mois pour en discuter avec le ministère de l’Économie et des Finances (et son organe compétent, la Direction générale des entreprises) qui doit publier une circulaire d’application avant le 1er janvier 2018 pour préciser ce décret. Les discussions pourraient être moins consensuelles que celles de ces deux dernières années.

“Les difficultés d’applicabilité de la Loi Sapin au programmatique restent entières. Le décret n’apporte effectivement pas de réponses aux questions que le marché se pose : les SSP et les DSP sont-ils des vendeurs d’espace ? Et les ad-exchanges ? D’un point de vue contractuel, ils se présentent comme de simples intermédi-ires, mais dans la pratique, ils agissent comme des vendeurs d’espace. Je rappelle au passage que la Loi Sapin interdisait déjà d’être à la fois vendeur d’espace et acheteur, elle n’est simplement pas respectée sur le digital. Mais aucun annonceur ne va aller en justice, c’est trop de temps et d’énergie perdus”.

S’assurer de l’exécution effective des prestations

“C’est ce à quoi servait la pige à ses débuts en presse. De même pour les services de contrôle de diffusion interne en agence média. Il y avait par exemple des suspicions sur la diffusion des spots chez les Indépendants en radio. Que c’est triste d’en être encore là !” “Mais quid des créations adaptées à l’individu avec le principe de la dynamic creative optimization (CDO) ? Quelle création va servir de référence pour le contrôle et le reporting ? »

“Qu’appelle-t-on exactement “montant global facturé (…) relatif aux espaces” ? Uniquement l’achat média ? La data nécessaire est-elle liée ? Le temps passé à programmer la campagne aussi ? Il faut fournir le CPM ou le CPM chargé?”

2° Au titre des informations permettant de s’assurer de la qualité technique des prestations :

a) Les outils technologiques, les compétences techniques ainsi que les prestataires techniques engagés dans la réalisation des prestations ;

b) L’identification des acteurs de conseil, distincts des prestataires de technologie numérique, impliqués dans la réalisation des prestations ;

c) Les résultats obtenus par rapport aux objectifs qualitatifs définis par l’annonceur ou son mandataire avant le lancement de la campagne tels que le ciblage, l’optimisation, ou l’efficacité ;

“L’ensemble de ce paragraphe est destiné à apporter plus de transparence dans le travail des acteurs de la chaîne de l’achat média, c’est forcément très positif !”

3° Au titre des informations sur les moyens mis en œuvre pour protéger l’image de la marque de l’annonceur, toutes les mesures mises en œuvre, y compris les outils technologiques, pour éviter la diffusion de messages publicitaires sur des supports illicites ou dans des univers de diffusion signalés par l’annonceur comme étant préjudiciables à l’image de sa marque et à sa réputation ; Des informations sur les moyens mis en œuvre pour protéger l’image de la marque

C’est la consécration des outils d’adverification et de qualité média, tels qu’Integral Ad Science, Adloox, AppNexus/Alenty ou Meetrics, et de leur importance pour les annonceurs.

4° Le cas échéant, les conditions de mise en œuvre des engagements souscrits dans le cadre de chartes de bonnes pratiques applicables au secteur de la publicité digitale. En outre l’annonceur pourra avoir accès aux outils de compte rendu mis le cas échéant à la disposition du mandataire.

“Ce point renforce le crédit apporté aux recommandations, chartes et labels qui sont en place ou vont l’être. On pense notamment aux recommandations de l’IAB US, qui sont en passe d’évoluer, mais aussi au label SRI-Udecam qui est annoncé pour la fin du premier semestre, ou aux chartes entre régies, agences et annonceurs.”

Article 4

Les dispositions du présent décret ne s’appliquent pas aux vendeurs d’espaces publicitaires établis dans un autre Etat membre de l’Union européenne ou partie à l’Espace économique européen lorsqu’ils sont soumis, en application de dispositions du droit national de cet Etat, à des obligations équivalentes en matière de compte rendu.

C’est un point qui interroge. On sait que les autres pays n’ont pas de texte légal aussi strict et spécifique à la publicité en ligne que l’est la Loi Sapin en France. Quid du terme “obligations équiva-

lentes en matière de compte-rendu ?”

“C’est confus. Est-ce à dire que des vendeurs d’espaces basés à l’étranger pourront se prévaloir d’obligations de compte-rendu alternatives moindres dès lors qu’une disposition juridique existe, même minimaliste ? Ce principe peut encourager certaines régies ou agences à centraliser leurs activités programma tiques dans un autre pays que la France où la loi et le cadre juridiques sont plus flexibles. Les régies françaises seraient encore les dindons de la farce.”

“Cela accorde un peu plus de dix mois au marché français pour s’adapter, mais aussi pour préciser le sens du texte. Une circulaire d’application devrait en effet détailler la mise en œuvre de ce décret et pourquoi pas apporter des réponses : qui sont les vendeurs d’espaces sur la chaîne programmatique et qui ne l’est pas ? Faut-il distinguer les vendeurs d’espace des vendeurs de prestation ? Quel niveau de détails le reporting à l’annonceur doit-il contenir et sous quelle forme ?”

“J’ai du mal à comprendre ce texte. Les régies françaises ont visiblement perdu la première étape des discussions. Le texte fait peser sur elles toute la responsabilité du reporting. J’ai du mal à concevoir comment elles pourront répondre au niveau de détail demandé sans accès aux informations. En parallèle, il y a très peu de nouvelles obligations pour les agences en qui concerne la responsabilité de l’environnement média, la délivrabilité des campagnes, la garantie de diffusion, etc. À mon sens, il y a peu d’avancées pour les annonceurs, c’est la validation de pratiques du marché.”

“Les motivations qui ont justifié de préciser la Loi Sapin sont évidemment bonnes, mais je ne pense pas qu’une loi puisse résoudre des questions aussi complexes que celles que pose le marché de la publicité en ligne : la loi sera nécessairement inadaptée, imprécise ou en retard. Et le niveau de détail demandé ici dans les compte-rendus sera d’ailleurs inapplicable. La réponse se situe plutôt à deux niveaux : en haut, il faut que les différents acteurs représentatifs du marché travaillent ensemble, se mettent d’accord et établissent des bonnes pratiques. En bas, la solution est contractuelle, pas légale : il faut que l’annonceur mette en place des méthodes de travail et des engagements clairs dans ses contrats avec les agences.”

« Les contenus pour adultes favorisent l’adoption de nouveaux formats médiatiques », une phrase tiré de cet article de l’INA (2014) qui rappelait que le choix fait par l’industrie pornographique avait imposé le format VHS vs Betamax pour les cassettes vidéo, l’adoption rapide du haut débit, le paiement sécurisé en ligne… L’arrivée des réseaux sociaux a réduit cette influence. Dans cet article, il est fait référence à une étude de 2012 estimant que 30% du trafic internet concernerait des contenus pour adultes.

La luxure depuis 1979 (slogan). Très bonne présentation de Gregory Dorcel, le fils du fondateur.

Dorcel en chiffres :

Et de l’innovation permanente

Sur la 3D, un positionnement fort, la première expérience utilisateur basée sur le jaillissement (sic), ce qui sort de l’écran (en 3D) … Ça a suscité sa prise de conscience sur le fait d’investiguer de nouvelles captations et de nouvelles narrations.

Avec l’effondrement de la 3D, ils sont passés à la VR, sur la même logique, avoir une expérience utilisateur bluffante.

Nous parlons plus de 360° que de réalité virtuelle proprement dite. Les difficultés rencontrées ont été de trouver :

2 films ont été produits, un soft et un X (accessibles ici). Efficacité ? 104 938 téléchargements et 12 000 ventes payantes (9€) pour une production de 120 000 € qui pourra descendre 60 000 avec l’expérience.

D’autres vont venir et notamment, un film fait en se mettant à la place de la femme alors que les premiers sont réalisés en étant à la place de l’homme. Les femmes journalistes qui ont vu les films ont donc eu une expérience dans la peau d’un homme, elles ont été surprises.

Quels constats et perspectives ?

Un marché ?

Selon une étude de Goldman Sachs, non pas axée sur le porno, mais sur le vidéo Entertainment, le marché serait, en 2025, de 3.2 milliards de dollars et généralement le porno représente 10% de ce business, donc beaucoup d’argent ! Le secteur le plus touché par cette révolution, sera le streaming, là où est le marché du porno aujourd’hui.

L’après VR ? L’hologramme ? car on est dans son salon et on peut y être à plusieurs…Jean Luc Mélanchon précurseur ?

A la fin de son intervention, la queue s’allongeait pour lui poser des questions ou proposer des services.

Quelle stratégie dans les expériences immersives ? Gilles Freissinier, Directeur du Développement Numérique, ARTE France.

Arte s’impliquant dans la VR, c’est logique puisqu’Arte a toujours innové dans les supports (pour mémoire Arte+7 a été le premier service de replay avant M6 replay) mais, pas seulement. La stratégie initiée par l’excellente Véronique Cayla, a été de faire d’Arte un media global où les supports utilisés doivent correspondre à des expériences audiovisuelles différentes qui prolongent le simple flux d’un programme.

La VR est à la confluence de la narration interactive, du jeu vidéo et de la narration audiovisuelle.

La première expérience d’Arte a été faite en 2014 avec Polar sea. Aujourd’hui, la VR d’Arte est une application, Arte360, où l’on voit la stratégie éditoriale d’Arte :

Tout ceci a un but, attirer de nouveaux publics vers Arte avec un plaidoyer européen que même si les casques sont tous d’origine étrangère, les productions européennes sont les plus populaires sur ce marché de la réalité virtuelle (vive l’Europe!).

Comme pour Gregory Dorcel, une queue pour des questions ou des services à la fin de l’intervention de Gilles Freissinier, mais des individus plus âgés !

Guillaume Esmiol (L’assistance était plus nombreuse pour Grégory Dorcel!)

Le but de TF1, toujours première chaîne d’Europe, est de divertir les gens, les faire rêver. La VR répond à cet objectif, faire vivre des expériences à des individus comme KohLanta ou the Voice.

Un marché ?

On est proche du million, chiffre significatif pour que TF1 puisse s’y intéresser.

Mytf1 VR a alors été créée avec comme « contrainte », un catalogue varié avec ou sans casque (en attendant un parc de casque plus grand) et un téléchargement possible (pour les zones mal desservies en connexion). Le catalogue comporte du contenu d’exploration type « Pyramides en Egypte », du sport et des sensations fortes, des reportages 360°. Les émissions phare de TF1 ne sont pas en reste, avec The Voice VR. Une fiction est annoncée pour mars avril 2017: Sergent James.

Les résultats de la première édition de The Voice, 120 000 sessions d’une durée de 6 minutes en moyenne. Cette durée semble être la norme pour les gros programmes au niveau international. Après 9 minutes les gens se lassent.

Et comme TF1 vit de la publicité, est proposé aux annonceurs, une immersion totale vs la multiplication des écrans (bataille de l’attention), l’interaction avec le produit, et une approche servicielle.

Un cas a été fait par TF1 avec le ClubMed. Cet annonceur voulait proposer à ses clients, en agence, une expérience unique et avait pensé à la réalité virtuelle.

ClubMed travaillait déjà avec TF1 Production pour des vidéos classiques et a donc pensé à son fournisseur habituel pour faire cette réalité virtuelle. TF1 production est allé chercher Total Immersion (Pour ceux qui ne connaissent par Total Immersion, c’est une société française, basée à Suresnes, pionnière mondiale de la réalité augmentée qui creuse son sillon, aussi, maintenant dans la VR). 12 films sur 12 clubs ont été faits, 2 autres vont venir encore. Julien Lebreton de ClubMed, est enthousiaste !

Mélanie Peron, bibliothécaire (en breton) de Laval, à créée une société l’effet papillon et une application VR, BLISS, dont la finalité est de fournir au milieu médical, les moyens de réduire l’anxiété et le stress des malades dans des situations difficiles (la leucémie de son compagnon a été le moteur de son changement). Il s’agit de détourner l’attention des malades via la Réalité Virtuelle. D’un premier essai avec Kinect pour des malades en chambre stérile, elle en est maintenant à de la vraie VR et en cours d’agrément médical. Les études qui sont menées récemment montrent, par exemple, que pour les grands brulés, la douleur est réduite de 30% grâce à la VR. L’effet est prouvé aussi sur les migraines et dans de nombreuses situations. La VR permet aussi de réduire la prise de médicaments par le malade (un exemple pendant une ponction de moelle osseuse) mais aussi permet au chirurgien d’être plus détendu, uniquement, grâce au relâchement du malade.

Karim Ben Khelifa, photographe de guerre, s’est posé une question « à quoi peuvent donc servir les images de guerre si elles ne changent pas le rapport des gens à la guerre, aux souffrances qu’elles engendrent, à la violence ? » Il a fait d’abord une exposition de photos mettant cote à cote 2 ennemis, mais, suite à une visite au MIT, il a voulu qu’existe une expérience immersive de réalité virtuelle où l’audience est invitée à se déplacer au milieu des face-à-face de combattants des conflits.

Pour concrétiser cette idée, il a donc fallu, aller sur des zones de guerre (1ere expérience conflit israélo-palestinien) avec un matériel le plus léger possible capable de supporter des conditions difficiles, choisir des combattants de chaque côté (1 Israélien et 1 Palestinien). Ceci a abouti à une expérience immersive destinée aux musées ou expositions culturels car la zone d’immersion doit faire 300 m2 pour recevoir 20 personnes en même temps qui vont interagir en se plaçant d’un côté ou de l’autre, ceci pendant 50 minutes. Le lancement en France, Canada, Usa est prévu pour cette année. En 2018, retour en Europe et lancement ensuite dans les zones de conflit.

De la première expérience Israël/Palestine, un élargissement a été fait sur les conflits du Congo et du Salvador. Très beau projet.

Des conférences intéressantes, un monde dingue à ce salon (pas forcement pour les conférences en cette journée grand public), des expériences sympas à faire (des queues extrêmement longues).

Un constat, il y a une corrélation très forte (causalité ?) entre la réalité virtuelle et la barbe, la densité de barbus était impressionnante !

Pour les adeptes, vous avez MK2 VR à côté de la grande bibliothèque à Paris où vous pouvez utiliser 5 ou 6 applications (Top !).

Comme d’habitude un compte-rendu partiel et partial !

Plein de « tronches » (ils me pardonneront !) ! Excusez du peu, Pierre Louis Lions, collège de France et Médaille Field (le Nobel de mathématiques), Jean-Michel Lasry, Normale sup, Dauphine, Emmanuel Bacry, professeur à Polytechnique (l’X)… Et aussi, une star, dans un autre genre, Dominique Delport (Global MD Havas Media Group et Président Vivendi Content).

Ils ont en commun, le rachat, il y a quelques années, par Havas Media (HM), de MFG Labs (PL Lions, H Verdier (Etalab), …) et le sponsoring de ces rencontres par HM avec Arnaud Parent (Président Havas Media Labs Global) comme co-organisateur avec Emmanuel Bacry.

Pour les autres, euh… je n’ai rien compris où je suis partie avant la fin, regardez le programme !

Le sujet était innovation et économie collaborative dans une table ronde.

Essayer de résumer l’intervention de Dominique en une image, est osé, nous avons essayé de le faire…ça va, c’est bon, pour le début mais pas pour toute l’intervention !

Donc, en complément de l’image ci-dessous qui dresse un portrait de l’évolution du marché avec le digital, D. Delport s’est interrogé sur la question de nos données individuelles : où est la valeur ? Les plateformes qui privatisent tout, sont dangereuses car en plus « the winner takes all », il tue ses concurrents.

Il a pris l’exemple du marché de l’Entertainement, aujourd’hui, scindé en 2 : les contenus gratuits et les contenants payants.

De façon générale, toutes les entreprises qui ont parié sur le digital et la data, sont en croissance. Mais le ticket d’entrée est désormais presque au milliard d’individus. L’Europe, le plus grand marché du monde, doit être plus ferme pour sa souveraineté numérique.

(Son patron, D. Delport, a dû être fort satisfait de cette très bonne intervention. A la fin de celle-ci, Benjamin Devienne a regardé de suite la réaction de D. Delport).

Gameloft, un des leaders du jeu en ligne (3 millions de joueurs par jour), propose un très gros catalogue de jeux. La croissance de la société est conditionnée, entre autres, au fait que ses clients jouent, de plus en plus, à des jeux différents dans son catalogue. C’est une logique business. Donc, comment faire ? Comment recommander à ceux-ci, tel ou tel autre jeu.

Pour cela, il suffit de regarder les fourmis (sic !). Celles-ci cherchent toujours le meilleur chemin pour aller vers quelque chose, un point précis. Pour cela, certaines avancent à droite ou à gauche, individuellement, et laissent, au passage, des phéromones sur le chemin. Plus il y a de phéromones sur un chemin, plus celui-ci est bon, car de nombreuses fourmis l’empruntent. C’est cela, la recommandation. Le modèle utilisé par Facebook basé sur la théorie des graphes et les probabilités est dans cette lignée.

Chaque individu est connecté à un ou plusieurs jeux, et Gameloft veut identifier le chemin le plus long que son client doit emprunter dans son catalogue pour qu’il accroisse sa pratique des jeux. Gameloft cherche à maximiser la « life time value » du réseau.

Le catalogue des jeux Gameloft peut être cartographié (volontairement flouté par l’intervenant).

Les grosses licences sont en rouge et tous les jeux sont reliés ou non entre eux.

Avec cette cartographie, Gameloft est capable de prédire à 80%, les déplacements dans le réseau.

Qui dit bonne prédiction, dit croissance du profit avec une augmentation de 400% des revenus grâce à la recommandation. Il leur suffit d’une journée pour savoir si la personne restera sur le jeu grâce auquel elle est arrivée et, 3 semaines pour savoir si elle est « bougeable » ou non grâce à des recommandations qu’on lui insufflerait.

Le fait de maximiser le réseau, donne un avantage concurrentiel énorme à Gameloft.

Pour augmenter le bassin de joueur (la pénétration), ils font naturellement de la publicité et peuvent même acheter certaines « adresses » (IP, mail…), à 40 € par joueur, car des joueurs peuvent dépenser jusqu’à 150 000 où 200 000 € par an.

Envoyer des recommandations, ou les susciter, permet aussi d’augmenter la puissance de la marque et la confiance en celle-ci.

L’analyse des trous dans le graphe , dans le réseau, autorise aussi une approche stratégique du catalogue.

(Une bonne présentation avec un intervenant qui a l’air adorable même si nous n’avons pas compris toutes les formules!)

En France se trouve, un des grand centres d’Intelligence Artificielle de Facebook (FB), à Paris.

L’idée globale est d’identifier les images qui se ressemblent.

Facile ? Oh non ! Car, pour savoir si elles sont similaires, il faut être capable :

Et en plus, il faut faire cela quasi instantanément. Donc, un travail sur des masses d’information et de calculs en temps réel !

L’intelligence artificielle est au pouvoir et ce ne sont pas les données FB qui sont utilisées par ses chercheurs, mais des jeux de données publiques pour être à même de comparer leurs résultats.

Hervé Jegou et son équipe, ont atteint leur objectif et vont mettre en OPEN SOURCE leur méthodologie et programmes pour le bien de tous, d’ici 6 mois. Merci !

Pour Veolia, la transformation digitale, ce sont les infrastructures technologiques qui doivent permettre de fournir un bien de plus en rare, l’eau, et faire en sorte, qu’elle soit propre pour les individus.

Les objets connectés sont en première ligne pour assurer de la maintenance prédictive (réparer, changer avant que cela ne casse) via des alertes vers un centre de contrôle. Ces capteurs technologiques ne suffisent pas. L’écoute des individus permet de comprendre leurs organisations communautaires car la ville est tout autant structurée par des groupes humains que par la planification de l’organisation territoriale.

Quelques informations en bref :

Dassault Systèmes est une société pionnière pour toutes les applications 3D.

On part forcément d’une vision de la ville de demain :

Par rapport à cette vision de la ville, Dassault Systèmes (DS) propose une plateforme où les données sont dites au service de la ville. On part de la connexion des choses ensemble (le citoyen, les services publics, le travail, …), puis la collecte des informations, leur analyse (big data car les données sont structurées ou non structurés, statiques ou temps réel, sensibles ou non, évolutives …), le design de la ville (en 3D bien sûr), la simulation, le suivi (monitoring).

Expérimentation à Rennes et, plus gros, à Singapour. Dans cette ville, 50 000 étudiants ont été équipés d’un appareil captant une multitude d’informations dans la ville de façon à nourrir la plateforme en information (expérience NSE.sg).

De façon générale, Raoul Jacquand estime que la prochaine frontière est le sous-sol, et que l’enjeu est de connecter dessus et dessous.

Le seul problème évoqué est le modèle business de tout ceci car qui paye ? les villes ? le privé ? … Où se trouve l’argent pour ce type d’approche essentielle au futur des villes.

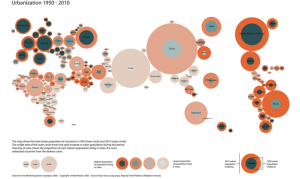

L’image ci-dessous (en cliquant vous allez sur l’image originelle), montre l’évolution de l’urbanisation par pays, entre 1050 et 2010, regardez bien, c’est la carte du monde qui se dessine.

https://www.researchgate.net/figure/273415304_fig1_Fig-2-Global-differentials-in-past-and-projected-urbanization-based-on-data-of-the

Selon lui, il faut dépasser la vision géographique des villes qui structure, actuellement, les réseaux d’énergie, pour aller vers les smart grids (optimisation de l’électricité via le digital). L’exercice est complexe, car les décisions urbaines sont à prendre pour l’heure qui suit ou pour les années futures (10 ans pour des équipements lourds).

En bref, la Chine construit chaque année une ville comme New York.

Ouvrir les boites noires du Machine Learning urbain (Un seul défaut, 10 choses importantes à la minute quand il m’en faut une par minute pour tout intégrer !)

Il est bien parti du sujet sur la ville mais nous a emmenés beaucoup plus loin sous ce prétexte.

Donc la ville a évolué au travers des âges en démarrant par une ville marché, forte et souvent sacrée (moyen âge), à une ville cosmopolite (révolution industrielle), pour devenir une ville flux de données.

Ces flux peuvent s’organiser selon 2 axes (cf photo-ci-dessous) :

Ces 2 axes permettent de placer, d’un côté, les approches collaboratives et les relations d’affection des individus envers la ville, de l’autre, les opérateurs qui intègrent, suscitent ou analysent des données urbaines (IBM, Google…). La notion de données réelles ou prédites est là pour les séparer.

Cette approche, sous 2 angles, permet de comprendre l’influence probabiliste dans le machine learning (les méthodes qui permettent d’apprendre aux machines à réaliser des taches complexes). Elle autorise le placement, dans chaque cadran, des outils qui existent pour classer et analyser les données.

Mais, le plus souvent, ce n’est pas UNE méthode, mais un assemblage de plusieurs qui est mis en œuvre. Il constitue, très (trop) souvent, une boite noire. Celle-ci n’est blanche (ou grise) que pour ses créateurs sans qu’ils aient même bâti un modèle conceptuel sous-jacent.

Il y a un enjeu de démocratie autour de tout cela, les boites noires doivent être rendues transparentes pour que le citoyen, l’individu, profite des données et non pas subisse les données.

L’approche smart city d’IBM pour les jeux de Rio, analyse ou fournit des « image fixes » de l’homme et de la ville. Aujourd’hui, nous sommes dans une époque d’images animées, de modèle d’apprentissage, où toujours plus de capteurs fournissent toujours plus d’info sans que les résultats soient là. L’attentat de Nice en est la preuve. La présence du camion enregistrée sur les vidéos durant plusieurs jours avant l’attentat, n’a pas permis de détecter quoi que ce soit, aucune alerte. Londres intègre, dans des tableaux de bord, les données de « mood », d’humeur des londoniens et l’analyse de sentiments issue des réseaux sociaux. Cela ne sert à rien car aucune alerte n’y est reliée.

L’approche de Google, la Google city, est basée sur les connections, les flux. Cette vision permet, à d’autres sociétés, de proposer, par exemple, des services de police prédictive. Le plus souvent elles survendent les résultats de leurs modélisations de type « boite noire ». Un contre-exemple, Hunchlab qui joue la transparence dans sa méthode, c’est le machine learning responsable.

En conclusion, il faut des contrôleurs/auditeurs de ces boîtes noires et une clarté dans les modèles conceptuels sous-jacents.

Pour lui, seule l’innovation est le moteur de la croissance à long terme. Et pourtant, l’innovation est la destruction créatrice (pas faux !). Mais pour créer, on ne peut être seul. Nous devons nous confronter aux autres et, pratiquer, à la fois, compétition et coopération : la coopétition. Un bon exemple, le MIT et Harvard qui sont en compétition farouche pour faire venir des professeurs mais qui arrivent à s’entendre pour des travaux en commun.

Du coup les innovateurs sont dans des zones densément peuplées et la révolution digitale a changé la façon de produire des biens et services mais aussi la génération d’idée.

L’innovation n’a jamais été aussi grande que maintenant et il faut organiser l’état et la société pour qu’elle soit en mesure de vivre l’innovation.

Et pour finir, Pierre-Louis Lions a dit

© 2024 tracksandfacts tracks&facts tracks & facts

Theme by Anders Noren — Up ↑