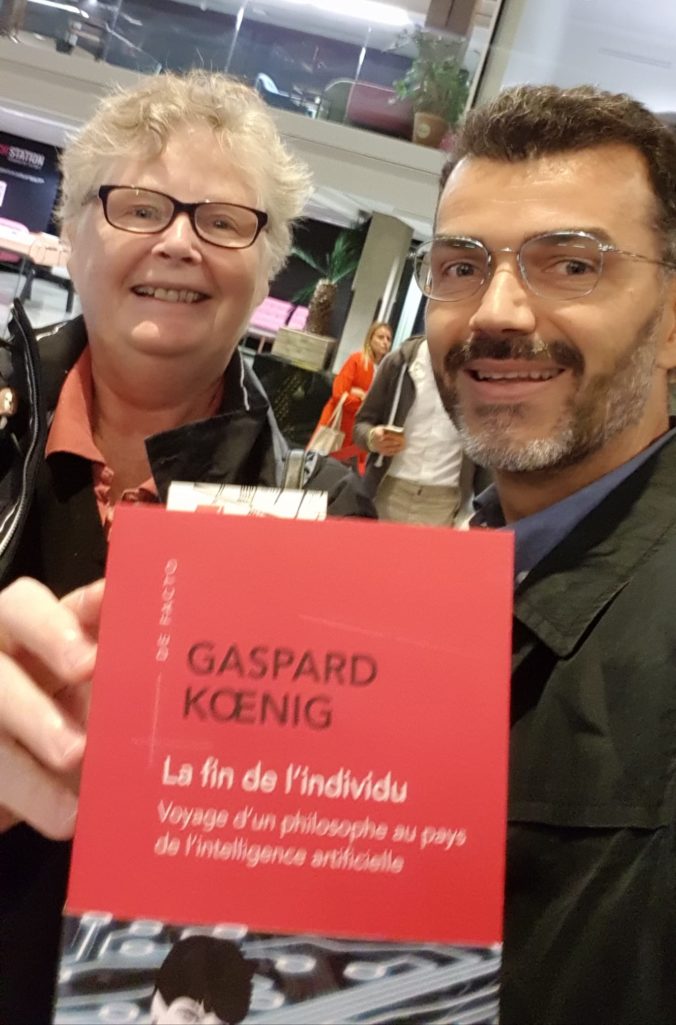

Comment résumer, en quelques lignes, une journée entière consacrée à l’intelligence artificielle le 23 octobre 2019, à Station F ?

Impossible d’autant plus que le programme était d’une richesse incroyable variant les mathématiques, la politique, le business, les enjeux, la pratique, les secteurs et 2 stars : Stéphane Mallat (Collège de France) et le montréalais Yoshua Bengio, l’un des 2 papes de l’IA avec le français Yann Le Cun (Le premier travaille pour Google, le second pour Facebook).

Chapeau pour cette magnifique journée (1 800 personnes y ont assisté) même si nous regrettons (cela va faire vieux c..) une journée complètement en anglais alors qu’il y a très très peu de non francophones dans la salle (3 à la première présentation…). Au moins, les ¾ des présentations étaient plus que compréhensibles pour des francophones vu la prégnance de l’accent français en anglais !! On regrettera aussi quelques changements de programme impromptus sans que l’application spécifique soit à jour, et les tics de langage du type « amazing », « incredible », « guys » …

Bref, nous ressortons de tout cela avec quoi ?

L’IA n’a rien de magique (nous le savions mais cela a été dit clairement moultes fois) et de nombreux progrès, dans tous les domaines, sont encore à venir pour contourner tous les problèmes et biais posés. Par contre, le processus d’automatisation est en marche avec son cortège de solutions business (Nous n’avions jamais vu une conférence avec autant d’offres d’emploi à l’intérieur même des présentations !!)

Un cocorico. La France est devenue, ce jour-là, officiellement, le pays leader en Europe sur l’Intelligence Artificielle (avant la Grande Bretagne et Israël) avec le premier rang en matière d’investissements dans les startups dédiées au sujet. 570 millions d’euros au 1er semestre 2019 pour une année qui atterrirait à 1.2 milliards d’euros selon les estimations du cabinet Roland Berger et de France Digitale (qui reprend l’organisation de l’événement France is AI).

Nous ne relatons ici, dans cet ordre, que ce qui concerne la politique, la complexité, les biais et contournements des biais, le business, le pragmatisme, le feel good et un tout petit peu de mathématiques.

Politique

Nous avons un ambassadeur pour le numérique (et il est compétent), Henri Verdier (…, Cap Digital, Etalab,…) qui doit « couvrir » 4 thématiques dans lesquelles l’IA est forcément présente :

- Les grands sujets de cyber sécurité (nous vous rappelons une de nos obsessions : la question n’est pas de savoir si des crashs de cyber sécurité au niveau des états vont se produire mais quand ! Merci l’Estonie 2007…).

- La participation des états a la gouvernance d’internet

- La diplomatie économique

- La défense et la promotion des valeurs qui structurent nos sociétés

En fait, il est à la recherche d’une troisième voie, l’Europe, alternative au « sans contrôle publique » américain et au « tout contrôle » chinois. Pour y arriver quelles solutions ?

Les lois avec l’exemple du RGPD qui fait des petits au Japon, en Inde et est copié aux USA. Ce qui n’empêche pas la France, par exemple, d’assouplir sa position par rapport à la circulation libre de la data (free flow of data with trust), l’important étant de savoir comment s’organiser.

L’argent mais que sont les investissements de chaque état européen pris indépendamment par rapport aux milliards américains et chinois. Il rappelle que le succès n’est pas proportionnel à l’argent investi, au tera octet de data, mais au fait d’être malin.

Et des engagements forts (?) sur des principes, des valeurs et l’éthique. Il pousse à la création d’un GIEC de l’IA (pas bête) pour avoir des gardes fous, au dépassement des conneries venant d’un pays (ex : la classification trompeuse des tomates en légume aux USA, alors que c’est un fruit, car il y a 100 ans pour des raisons de taxes, Heinz a qualifié les tomates en légumes. Aujourd’hui toutes les bases de données américaines utilisées en IA des USA classent les tomates en légume au lieu de fruit !).

Le rôle de l’Etat, pour lui, est celui du jardinier qui doit faciliter la vie des startups.

Complexité

On est loin de « l’intelligence » artificielle. La voiture autonome sur la place de l’étoile ce n’est pas pour demain. Trop d’interactions, de décisions à prendre encore pour les machines existantes qui ne sont capables que d’imiter des taches simples et répétitives (c’est déjà ça !). Une machine sait faire un chose à la fois et ne peut pas tout faire ! Exemple, la machine alpha GO est bonne pour le jeu de GO mais ne sait rien faire d’autres, il faut tout créer à chaque fois.

Biais et contournement des biais

- Où sont les femmes (une fois de plus), quand on voit Karl Tuyls (Deepmind de Google et Université de Liverpool) qui remercie dans un slide de photos son équipe d’au moins 16 chercheurs, que des hommes ! Les organisateurs de la journée ont fait attention à ce point et des femmes étaient présentes sur la scène!

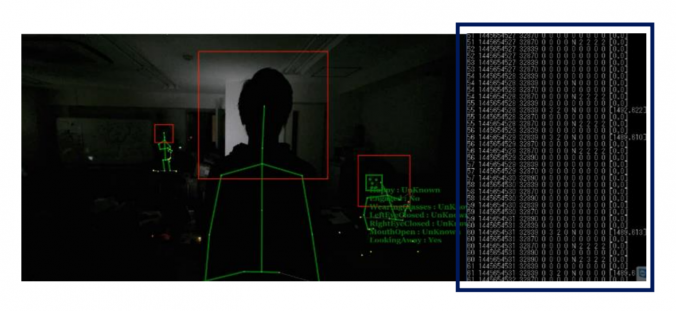

- Biais des bases de données. Les modèles d’apprentissage des machines (machine learning supervisés) sont très gourmands en données. Pour leur apprendre des choses, il faut que l’humain intervienne, par exemple, en annotant des milliers d’images de façon à expliquer à la machine ce que signifie telle ou telle image. La masse d’images annotées permettra alors à la machine d’être capable de classer correctement de nouvelles images rencontrées Il y a un très gros business autour des bases de données d’images annotées, décrites, par les humains (Inde, Madagascar,…). Mais c’est long, cela coute cher (même si ces travailleurs humains sont payés une misère) et cela ne couvre pas toutes les situations car il est dangereux pour l’humain de coder certaines situations (il doit visionner des atrocités pour coder !). Sans aller chercher ici les horreurs pornographiques ou terroristes, pensez simplement aux accidents entre un piéton et une voiture, vous ne disposez pas d’un « corpus » de cas, d’images, suffisants. Pourquoi ne pas les créer dans un monde virtuel alors (Naila Murray, Naver Labs), et avoir alors de la variété dans les situations qu’un grand nombre de situations identiques.

- Toujours sur les bases de données, imaginez 8 photos, 6 de chats blancs et noirs dans différentes positions et 2 de chiens noirs, eux aussi dans des positions différentes. Vous injectez dans la machine une photo de chien blanc pour classification en chien ou chat, la réponse sera chat, car toutes les photos d’un animal blanc était un chat ! Cela parait bête mais c’est une réalité que vous pouvez transposer à grande échelle. Cela renvoie à un biais très classique en stat, votre échantillon n’est pas représentatif de la population qu’il est censé représenter !

- En Autriche, une startup se faisait fort de réduire le chômage en fournissant un algorithme d’adéquation entre le profil du candidat et l’offre d’emploi à base de machine learning. Super sur le principe mais la machine a appris le chemin le plus efficace trouvé dans l’historique des données, ne proposer des offres d’emploi qu’aux hommes car ils décrochent des emplois quand les femmes et les personnes handicapées n’en recevaient plus aucune…

Business

Criteo

La publicité était présente à cette journée avec les changements de fond opérés par Criteo dans son fonctionnement (Zofia Trstanova). Comment changer son moteur de recommandation pour être plus pertinent et être capable de présenter le bon produit pour 1 milliard de requêtes / utilisateurs en 50 millisecondes… ? Joli challenge ! Bien sûr, il y a l’historique de l’utilisateur mais quel produit choisir dans les milliers, millions de produits possibles parmi les partenaires de Criteo (CDiscount ….) ? C’est simple, Il faut construire une matrice de distance entre produits et choisir le plus proche voisin du dernier produit acheté ou choisi par l’utilisateur. Cela parait facile mais la masse de produits et l’urgence de la réponse change tout. Il faut alors approximer les distances, approximer la matrice.

Le nouveau système Criteo a commencé à être déployé il y a un an et demi. Il va être amélioré par l’incorporation des annotations d’images dans le processus.

Astra Zeneca (James Weatherhall VP Data science et AI)

Le raisonnement est simple pour un laboratoire pharmaceutique. Un brevet dure 20 and, il faut 12 ans pour arriver a une solution définitive et sa mise en marché. Il ne reste donc que 8 ans pour obtenir des revenus. Comment raccourcir les 12 ans pour allonger les 8 de revenus ! La première étape est dans la connexion de toutes les données qui existent maintenant pour un laboratoire pharmaceutique (données génomiques et génétiques, données patients, données de capteurs, données d’interaction media, données des réseaux d’information médicaux, données de marché. La seconde étape est de connecter un certain nombre de ces données (ca a pris moins de 2 ans). Ensuite, et il y en a pour 5 ans encore, on applique de l’Intelligence Artificielle. Premier exemple, dans la découverte de médicament, les « manipulations » de molécule sont « facilement » automatisables. Ce qui prend aujourd’hui 24 jours pourraient baisser à 5 jours. Second exemple, l’interprétation radiologique dans des cas de tumeur. Un radiologue met 20 minutes, dans des cas complexes à analyser l’épreuve avec environ 10% d’erreurs quand un processus d’IA met quelques secondes avec moins de 1% d’erreurs.

Eramet (Jean Loup Loyer, Head of data sciences & AI)

Une société de production minière (Nouvelle Calédonie, Gabon…) et de métallurgie qui comme Astra Zeneca est maintenant à la tête de nombreuses données. Une des premières utilisations a été de faire de la maintenance préventive sur ses machines d’extraction grâce à l’analyse des données de capteurs. Mais en allant plus loin, Eramet analyse maintenant les images prises par drone des chantiers de ses concurrents ou clients pour adapter au plus juste sa production miniere et ajuster ses prix !

Société Générale (Julien Molez, Group Innovation Data & AI Leader)

L’analyse des données n’y est pas nouvelle (l’actuariat pour la gestion des risques) mais là encore, la masse de données issues des clients, de la dématérialisation des documents, permet d’aller plus loin. 3 cas d’utilisation de l’Intelligence Artificielle

- Analyse du langage (NLP) sur les clauses de confidentialité a signer avec des partenaires potentiels pour voir si elles sont compatibles avec la législation bancaire et la politique de la banque.

- Moteur de recommandation du bon article à lire au bon moment pour les clients de la branche affaires (et leurs conseillers)

- Analyse de tous les paiements de la banque en temps réel en France pour détecter les valeurs aberrantes (outliers) et bloquer les mauvaises transactions

Pragmatisme (Benoit Limare, Sicara)

Une fraîcheur de propos très agréable.

Pour lui il y a au moins 2 catégories de projet d’IA :

- L’IA bidon, la start-up qui dit qu’elle fait de l’IA (notamment en reconnaissance d’image) et qui a, en fait de nombreuses petites mains à Madagascar pour classer les images…

- L’IA raisonnable : démarrer petit pour élargir le champ par la suite. Le grand soir dans de l’IA est dangereux car il faut prouver l’intérêt de la méthode à la fois auprès des salariés proches de l’informatique mais aussi ceux qui sont touchés par le process et la direction générale. Commencer par quelque chose de raisonnable (voire même bidon) est le moyen d’amorcer la pompe, d’emporter l’adhésion de tous avant d’engager des coûts élevés dans un projet plus complet (l’IA ça coûte cher !)

Des exemples :

- Une société de produits de beauté voulant un moteur d’IA pour recommander le bon produit de soins pour la peau a de clientes avec déjà une bonne solution avec un selfie et quelques bonnes questions.

- Une autre où le DSI voulait réduire une tache de 15 minutes à 10 secondes. Un projet simple permettait déjà de réduire la tache de 15 minutes à 45 secondes. Le projet pour atteindre les 10 secondes aurait été extrêmement couteux.

Il rappelle que pour faire de l’IA, il faut des données (la moindre des choses !), lisibles par un humain (si l’humain ne les comprend pas, la machine ne saura rien faire), et contrôlables (autrement dit de nombreuses photos de produits différents d’un site de e-commerce prises toutes avec des angles différents débouchera sur des problèmes, il faut contrôler l’input !).

Feel good

Accenture a présenté un programme d’aide aux personnes âgées avec de l’IA conversationnelle. Le premier pilote d’« Elderly care » avait été fait en Grande Bretagne il y a 3 ans. 4 sont dans les « tuyaux », un en Belgique, 2 aux USA, 1 à Stockholm. Cela a raisonné beaucoup dans nos oreilles suite au petit dejeuner IREP que nous avions animé sur ce sujet avec Hélène Xuan et Olivier Altmann

Mathématiques

Un grand moment avec Stéphane Mallat du Collège du France qui, sur le moment, nous a paru biblique quand il expliquait comment les mathématiques pouvaient aider l’Intelligence Artificielle à résoudre le problème de l’interprétation des choses.

Pour lui, tout est dans la structuration des réseaux de neurones, il le démontre. Mais il a avoué avoir perdu, pour l’instant, un pari d’un diner dans un 3 étoiles (on est français où on ne l’est pas) avec Yann Le Cun quant au fait de trouver le modèle d’analyse et les théorèmes qui vont bien !

Au fait, si vous voulez comprendre vraiment « Comment les Réseaux de neurones à convolution fonctionnent » cliquez ! Ça vaut le coup car c’est la base de tout le décodage d’images entre autres. Si nous vous le disons avec nos mots, vous découpez votre image en pixels, chaque pixel a un poids en fonction de son contenu et de ses couleurs. Vous tordez votre image et refaites votre découpage en pixels. Ceci plusieurs fois, vous prenez un échantillon de pixels dans chaque découpage et à la longue vous mettez tous vos échantillons ensemble et vous serez capable de reconnaître une nouvelle image en la comparant via ses pixels à celles que vous aviez eu au préalable. C’est bien mieux expliqué dans le lien que nous vous signalons et nous venons surement d’écrire de grosses horreurs!!

En conclusion, l’IA était, pour nous, plus facile à comprendre que la conférence sur le gaming !