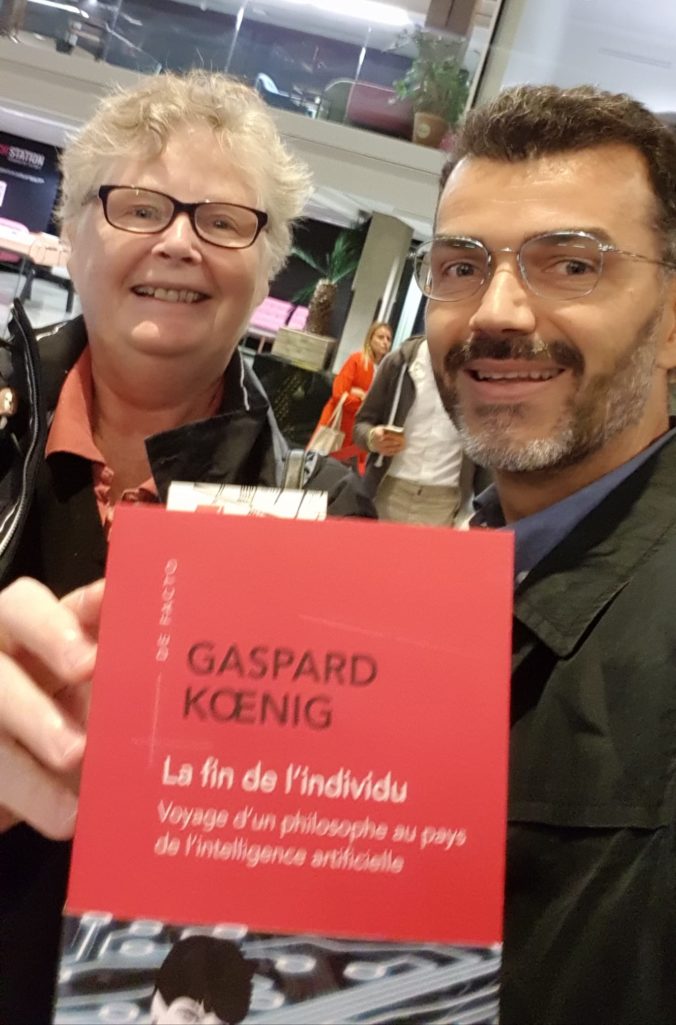

Nous avions déjà eu le plaisir d’écouter Gaspard Koenig (GK) lors d’une conférence TEDX Paris. Le 27 septembre 2019, il présentait son nouveau livre qu’il a « résumé » pendant une heure à Station F, (grand amphi complet). Ce compte rendu est fait sur ce « résumé » pas sur la lecture du livre (acheté mais non lu !).

Le sous-titre de ce livre pourrait être

« remettre l’église au milieu du village » !

Pour lui, il faut remettre l’humain dans l’IA, c’est-à-dire en maître de ses propres données.

Comment y arrive-t-il ?

Il a rencontré près de 120 chercheurs, entrepreneurs, intellectuels, magicien… en France, UK, Israël, USA, Chine … Bel effort (sponsorisé par Le Point) pour un philosophe non spécialiste de l’Intelligence Artificielle.

Au passage, GK fait remarquer que rencontrer des interlocuteurs sur ce sujet n’est pas facile, car ils sont pressés, stressés, soumis à des enjeux financiers importants et n’ont aucune envie de rencontrer un philosophe !

Quelques tacles :

- Ces interlocuteurs n’ont aucune culture. La référence la plus ancienne qu’il a pu entendre dans la bouche de ses interlocuteurs était … « star wars »

- Ce sont les physiciens qui ont toujours joué les « Cassandre » sur l’IA en se basant sur des théories très très peu probables alors que les mieux placés pour en parler, les informaticiens, sont eux réalistes (Yann le Cun, Facebook, sort un livre dans 15 jours sur le sujet) et savent très bien que l’IA est très très loin de cette prise de contrôle.

Alors faut-il avoir peur ou non de l’Intelligence Artificielle (IA)?

Dans l’absolu, Non ? mais…

Dans l’expression Intelligence Artificielle, il y a intelligence et celle-ci est le produit d’une évolution biologique depuis des milliers d’années qui nous a donné le pouvoir de conceptualiser. Donc, tant que l’IA en reste aux calculs de l’ordinateur, aucun risque de dépassement ou de rapprochement de l’homme par la machine.

L’IA et le travail ?

GK n’est pas inquiet sur ce que l’on appelle « la fin du travail ». Le travail étant un sens commun, l’IA ne peut le tuer car l’IA n’a pas de sens commun. Elle peut être très précise dans 99% des cas mais dans 1% elle conduit à de grosses « conneries ». Ces erreurs ne sont pas une histoire de répétitivité des taches, mais de sens commun. Ex : un serveur dans un café ne peut pas être remplacé par une machine car toutes les décisions qu’il doit prendre sont multiples et différentes à chaque instant et dans chaque lieu.

Il est probable que des métiers disparaîtront et se créeront. Le danger de l’IA peut venir si nous changeons notre environnement pour nous adapter à celle-ci. C’est ce qui semble se produire dans les ports gérés par les chinois où toute l’infrastructure est conçue pour l’IA et non plus pour l’homme. Nous avons à faire un choix de civilisation.

(Si on raisonne par l’absurde, il paraîtrait qu’1/3 des emplois sont des « boulots à la con » (les bullshit jobs). L’IA ne saura pas faire un boulot à la con !!).

IA et le libre arbitre ?

C’est sur ce point qu’est le danger, selon Gaspard Koenig.

Ces systèmes nous connaissent mieux que nous-même, ils connaissent notre environnement, ils nous donnent des conseils, ils nous conduisent à des choix optimaux. Nous allons alors leur déléguer notre capacité de choix. Cela signifie la fin du libre arbitre. Or, celui-ci est le fondement de nos systèmes sociaux (le fondement du système juridique américain par exemple).

On assisterait alors à une transformation culturelle radicale (chaos ?) car l’IA cherchera à optimiser la « performance » d’ensemble et non pas la performance individuelle, on irait alors vers « ce qui est le moins mauvais pour soi compte tenu d’un optimum pour l’ensemble ».

2 exemples :

- Google maps vous indique le meilleur trajet pour désengorger le trafic pas le trajet le plus court, l’itinéraire égoïste, que vous vous choisiriez probablement.

- Les applications de rencontres font face à l’illogisme humain. Les recherches ont montré que les femmes recherchaient un compagnon de leur tranche d’âge (une droite entre âge du demandeur et âge du demandé). Les hommes, bloquent leur curseur de compagne recherchée à 24 ans quel que soit leur propre âge (une asymptote). Les algorithmes ont alors besoin de nombreuses informations pour découvrir les désirs implicites sous des choix explicites, de façon à ce que l’ensemble du réseau soit satisfait.

IA et causalité ?

L’IA fait disparaître la notion de causalité et donc l’utilité des théories ou des lois.

Le fait de disposer de toute l’information permet de se passer de la notion de causalité.

Ex : la société Didi en Chine (le Uber chinois) a plus de 90% du marché des VTC en Chine. Elle dispose donc de toutes les informations. Cette société ne fait plus de politique de prix pour attirer les chauffeurs (offre et demande) vers certaines courses lointaines mais se contente de faire du dispatching de chauffeur pour assurer l’optimum d’ensemble. L’information étant complète, la notion de marché disparait. Il va plus loin en s’interrogeant sur la pérennité de la notion de justice, des lois en tant que telles.

IA et différences culturelles ?

Le Chine a fait de l’IA une priorité absolue tant sur le fond que sur le financement.

Les chinois n’ont aucun tabou, aucune limite, et ceci leur permettra d’atteindre un bonheur collectif. La passion de la Chine pour l’IA correspond parfaitement aux valeurs confucianistes qui reviennent en force. Les chinois parlent d’ailleurs de leurs inventions avec une grande candeur. Gaspard Koenig a alors projeté quelques verbatim comme « les jeux video permettent de rendre les gens accro pour mieux les contrôler (parti communiste) ».

Aux USA et en Europe, la prospérité allait de pair avec la liberté individuelle. L’IA remet en cause cette équation. Plus vous voulez de croissance, plus vous devez sacrifier la liberté individuelle, ce qui va à l’encontre des fondements mêmes des sociétés occidentales.

La notion d’impérialisme a d’ailleurs évolué en passant d’un impérialisme territorial à un impérialisme numérique dans lequel les gouvernements sont perdus.

Conclusion : un modèle alternatif ?

Le rétablissement de l’individu dans ses prérogatives humaines est le cœur de sa réflexion.

L’humain doit prendre conscience de l’extrême important du flux sortant des data, sa propriété privée, ses données personnelles. C’est notre bien et nous devons avoir le droit de le sortir du marché ou d’y rester !

GK fait la promotion des portefeuilles électronique de données : « Chacun doit pouvoir contrôler son propre nudge » !

Pour atteindre ce but, GK a besoin de « potes » listés ci-dessous. En cliquant sur chaque nom, vous verrez dans quelle lignée philosophique ou pratique ils/elle se situent.

Nous espérons que ce « résumé », loin d’être parfait, vous donnera envie de lire ce livre ou de réfléchir sur les notions de biens communs, libre arbitre, théorie, causalité et confucianisme.

(Et c’était chouette de retrouver Jimi Fontaine a cette conférence 😊)

Laisser un commentaire